Компания Luma представила Uni-1 — свою первую «универсальную» мультимодальную модель, которая не просто генерирует картинки, а сначала планирует результат и проверяет, совпадает ли он с задумкой. Проще говоря, модель рассуждает и только потом рисует.

Технически Uni-1 — авторегрессивный трансформер: она одновременно понимает текст и изображения, применяет знания о мире и умеет объединять несколько референсов в одну картинку. Luma утверждает, что встроенное «мышление» заметно улучшает визуальное качество результата. Для проверки компания создала собственный бенчмарк Rise Bench, который оценивает понимание времени, пространства, логики и причинно-следственных связей — то, с чем генеративные модели традиционно справляются хуже всего.

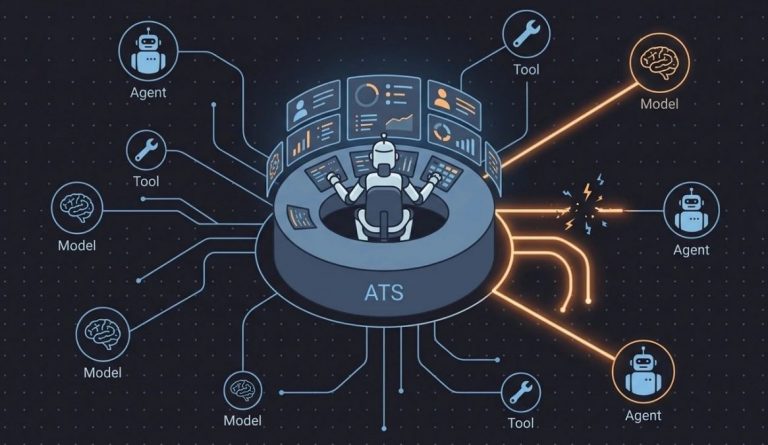

Параллельно Luma запустила Luma Agents — систему ИИ-агентов для создания рекламных кампаний. Агенты умеют придумывать сценарии и производить готовый контент, комбинируя сразу несколько моделей: видеогенераторы Ray 3.14, Google Veo 3 и Nano Banana Pro, а также голосовые модели ElevenLabs. Звучит как продакшн-студия на автопилоте.

Доступ к агентам уже получили крупные корпоративные клиенты, среди которых рекламные холдинги Publicis Groupe и Serviceplan, а также бренды Adidas, Mazda и Humain. Широкой публике Luma Agents пока недоступны, а цены не объявлены. Uni-1 появится в API — без конкретных сроков.

Пока Uni-1 работает только с изображениями, но компания прямо говорит, что цель — единая модель для картинок, видео и аудио. Учитывая, что в сентябре Luma выпустила рассуждающую видеомодель Ray 3, а в декабре версию для редактирования видео, темп у компании достаточно высокий.