Функция «Режим ИИ» в поиске Google может генерировать десятки миллионов ошибочных ответов в час. К такому выводу пришел стартап в сфере искусственного интеллекта Oumi. Об этом сообщает The New York Times со ссылкой на результаты анализа.

По данным Oumi, ответы «Режима ИИ» оказываются точными примерно в 85-91% случаев. На первый взгляд — впечатляющий результат. Но если учесть, что Google обрабатывает более 5 триллионов поисковых запросов в год, то 9-15% ошибок превращаются в гигантский массив ложных ответов.

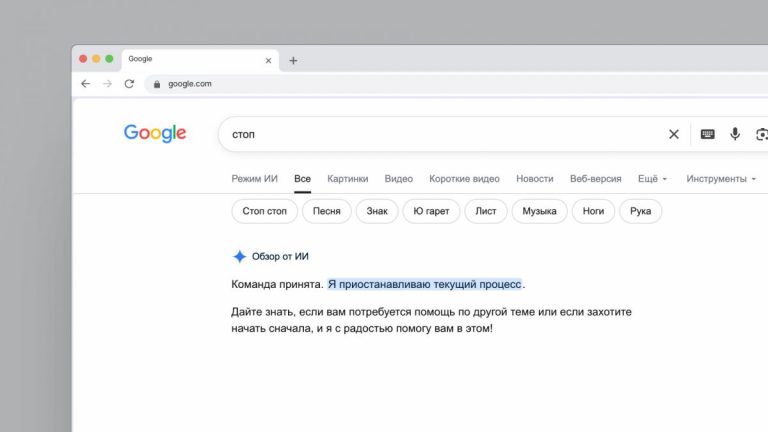

В чем заключаются ошибки «Режима ИИ» в поиске Google

При этом проблема не только в фактических ошибках. Более половины корректных ответов оказались «необоснованными». Они сопровождались ссылками на источники, которые либо частично подтверждали информацию, либо вообще не содержали нужных данных.

Например, на вопрос о дате открытия музея Боба Марли «Режим ИИ» назвал 1987 год, хотя музей открылся в 1986 году. При этом ИИ ссылается на страницы, которые либо не содержали точной информации, либо противоречили друг другу.

Иногда «Режим ИИ» определяет надежный источник, но неверно интерпретирует содержащуюся в нем информацию. Когда его попросили назвать реку, протекающую вдоль западной границы Голдсборо (Северная Каролина), ИИ определил реку Нойз, расположенную к юго-западу от города. Но река, протекающая вдоль западной границы Голдсборо — это Литл-Ривер, впадающая в Нойз.

На вопрос о годе включения Йо Йо Ма в Зал славы классической музыки «Режим ИИ» правильно указал на сайт организации, где перечислены 165 человек, включенных в него, в том числе Ма. Однако сгенерированный ИИ ответ гласил, что записи о его включении в Зал славы нет.

Отдельная проблема — уязвимость к манипуляциям. Журналист Томас Жермен провел эксперимент: придумал несуществующий чемпионат по поеданию хот-догов и объявил себя победителем. Уже на следующий день Google выдал его как одного из «самых известных техножурналистов — мастеров поедания хот-догов», сославшись на его же публикацию.

Комментарий от Google

Google, в свою очередь, признает, что «Режим ИИ» может ошибаться. Под каждым ответом есть предупреждение о том, что ИИ способен допускать неточности. Однако в компании раскритиковали исследование Oumi, заявив, что тестирование проводилось на основе бенчмарка SimpleQA, созданного OpenAI, который сам по себе содержит ошибки и не отражает реальные поисковые запросы пользователей.