Компания DeepSeek представила новые версии своей флагманской языковой модели искусственного интеллекта с открытым исходным кодом V4. Она поддерживает контекстное окно объемом до 1 млн токенов, что сопоставимо с объемом текста из 15-20 романов.

Вышли две модели:

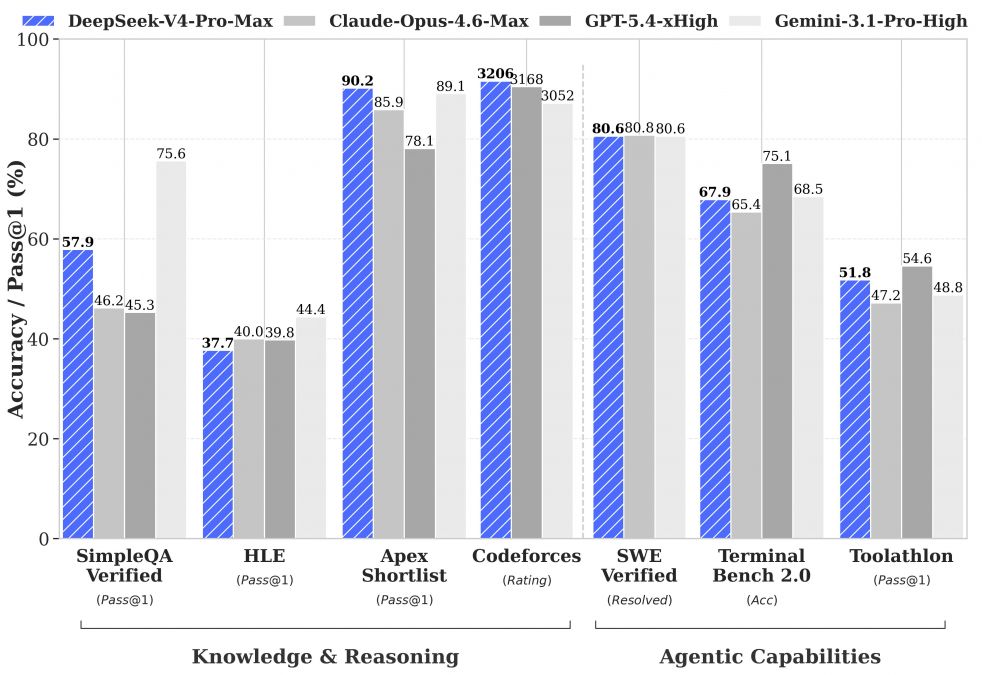

- DeepSeek-V4-Pro — 1,6 трлн параметров (49 млрд активных). Производительность, сопоставимая с лучшими в мире моделями с закрытым исходным кодом.

- DeepSeek-V4-Flash — 284 млрд параметров (13 млрд активных). Немного уступает Pro-версии по объему имеющихся данных, но предлагает более быстрый и экономичный API. В ходе оценки показала сопоставимые результаты с V4-Pro в простых задачах, но все же отставала в задачах высокой сложности.

Обе интегрируются в Claude Code, OpenClaw и OpenCode.

Согласно представленным данным, в тестировании MMLU-Pro, которое используется для оценки качества моделей в задачах по программированию и аналитике, DeepSeek-V4-Pro показала уровень, сопоставимый с GPT-5.4 от OpenAI. При этом модель немного уступила Gemini-3.1-Pro от Google и Claude Opus 4.6 от Anthropic.

Обе модели уже доступны на официальном сайте и в приложении DeepSeek.