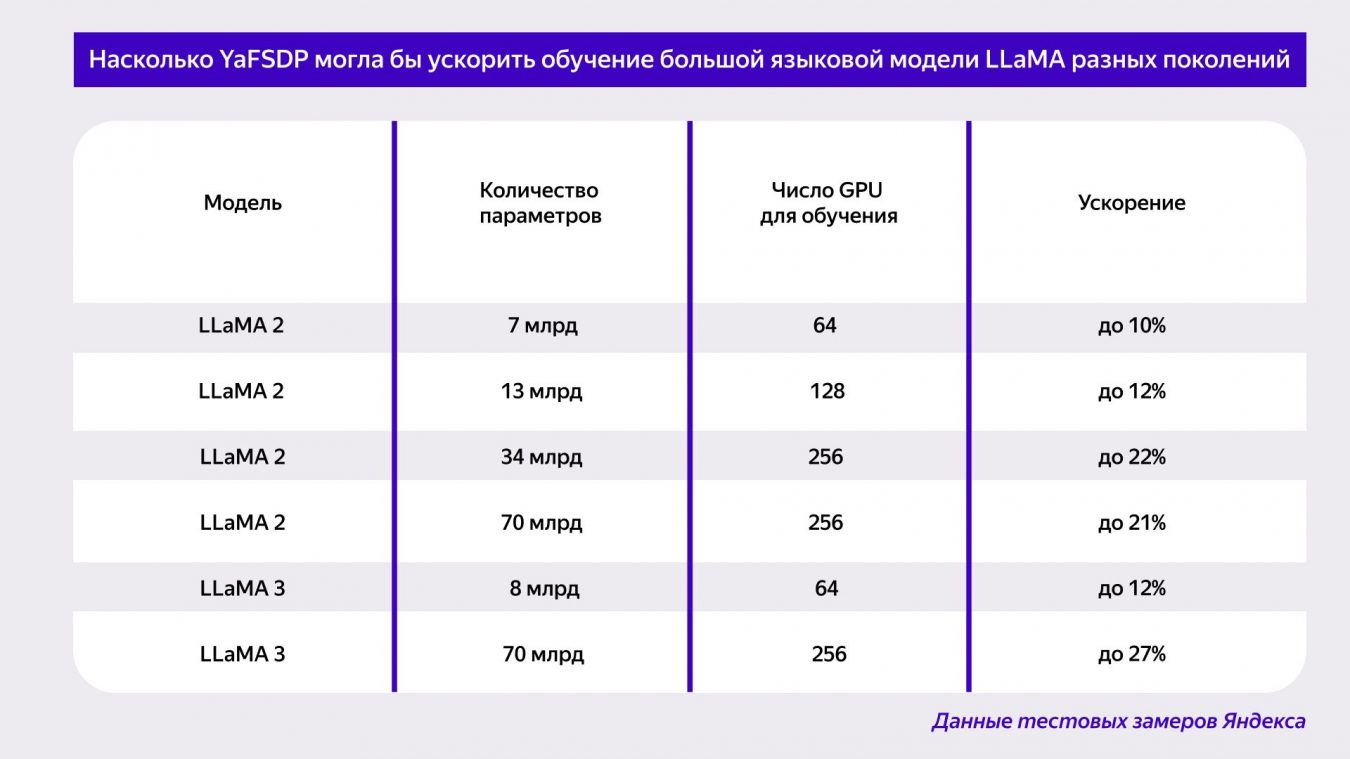

Яндекс выложил в открытый доступ инструмент YaFSDP, который ускоряет обучение больших языковых моделей до 25%.

С помощью библиотеки можно сократить потребление ресурсов графических процессоров (GPU) до 20%, необходимых для обучения. Теперь YaFSDP доступен для использования компаниями, разработчиками и исследователями по всему миру.

Библиотека Яндекса в первую очередь предназначена для больших языковых моделей, но также подходит и для других нейросетей, например, для тех, которые генерируют изображения. YaFSDP позволяет снизить расходы на оборудование для обучения моделей, что особенно важно для стартапов и научных проектов.

Яндекс разработал YaFSDP во время обучения своей новой генеративной модели YandexGPT 3. Компания уже протестировала библиотеку на сторонних нейросетях с открытым исходным кодом.

Исходный код YaFSDP уже есть на GitHub. Посмотреть подробности замеров можно в репозитории GitHub, а почитать про разработку библиотеки — на Хабре. Все опенсорс-решения Яндекса доступны на отдельной странице

Комментарии в Телеграм