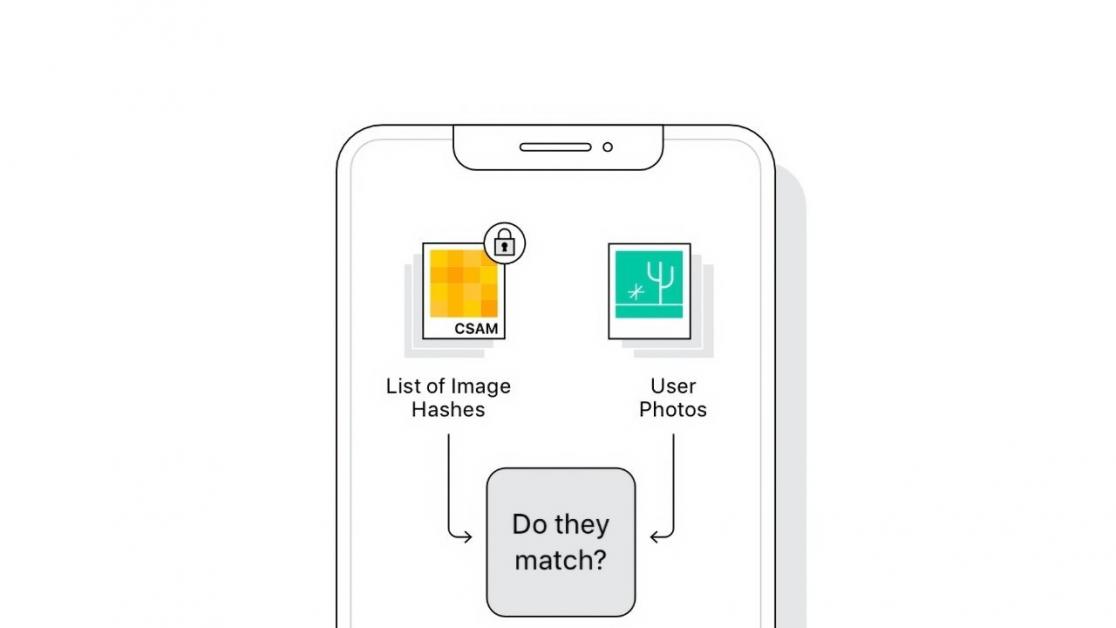

Разговоры об Apple и ее алгоритме сканирования фотографий, на которых может быть изображено насилие над детьми, набирает обороты. На днях наличие алгоритма в iOS 14.3 было подтверждено. Его нашел один из пользователей Reddit. Асухариет Игвар обнаружил NeuralHash в недрах файловой системы.

Впоследствии он его перенес на Python и выставил в общий доступ на GitHub. Теперь каждый пользователь может скачать скрипт и проверить свой ПК на наличие подобных фотографий. Если верить версии разработчика, то код и детали этого алгоритма, описанные в официальной документации Apple — совпадают.

Кстати, те, кто тестировал работу этого алгоритма пришли к выводу, что его можно обмануть. Делается это простым обрезанием изображения или его поворотом. Хотя это полностью отрицают представители Apple. А вот сжатие изображение или изменение размера не влияют на обнаружение таких фотографий. Напомним, что Apple в течение нескольких лет работала над этим алгоритмом.